大学、専門学校や企業などの研究室を訪問し、研究テーマや実験の様子をレポート

第27回 Part.2第27回 光センシングでVRやARの進化をめざす(2)

Part.2

人の表情をリアルタイムで

CGキャラクターに反映

情報工学科 杉本 麻樹 准教授

公開:

VR(バーチャルリアリティ)という言葉はすでに一般的な用語として定着し、AR(オーグメンテッドリアリティ=拡張現実)という言葉も知られるようになってきた。では、いまVRやARによってどのようなことが可能になり、どのような研究が進められているのだろうか。今回は、センシング技術をベースにVRやARの進化に取り組んでいる慶應義塾大学の杉本麻樹先生の研究室を訪ねてみた。(Part.2/全4回)

▲杉本 麻樹准教授

▲杉本 麻樹准教授

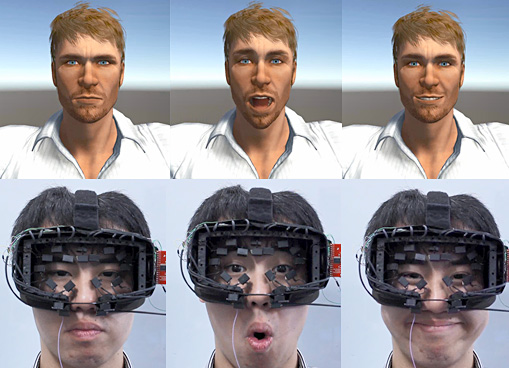

杉本先生の研究室では、光センシングの技術を応用して、人の表情をリアルタイムでCGキャラクターに反映する研究にも取り組んでいる。

「2016年は『VR元年』ともいわれ、その頃からコンシューマー向けのVRプロダクトが急速に広まってきていますが、VRではリアリティを高めるうえで、バーチャルな環境の中でいかに人の状態を測るのかということがすごく重要な要素になります。

たとえば、人の身体運動とか関節の角度を測るというようなことは、プロダクトを含めた一般的なVRシステムの中でも行われています。でも、測り切れていない情報というのがまだまだたくさんあります。その1つが人の表情です。そこで、我々は光センシング技術によって表情を計測し、それをバーチャルなCGキャラクターに反映させることを考えました」

光の反射強度をセンシングして

表情の変化を読み取る

この研究では、オーグメンテッドコロシアムのときのプロジェクタから投影していた光の代わりに、頭部装着型ディスプレイ(HMD:ヘッドマウンテッドディスプレイ)の内側でLEDから発する光の反射強度をセンサーで計測することがポイントになっているという。表情は顔のさまざまな部分の動きによって構成されるが、その動きによる顔面の変化をセンサーからの距離に応じた反射の強さとして読み取る試みだ。

「我々は、HMDに光センサーを組み込んで表情を測っていくことができるシステムを構築しています。

計測をしていくうえで、まず、人の表情というものは基本表情の組み合わせによって表現できるだろうということを前提にしました。たとえば、ニュートラルな表情、笑っているような表情、怒っているような表情、驚いているような表情、悲しんでいるような表情などがありますが、こういった基本表情を組み合わせることで、そのときどきの表情を推定し、CGキャラクターで表現することを考えたのです」

HMDにはLEDとセットになった反射型の光センサーが16個取り付けられている。それぞれのLEDから発した光が顔から跳ね返ってどれだけの強さで戻ってきているかを測っているのだそうだ。

「この研究では、光の反射強度を学習することで表情を識別しています。光を反射する対象とセンサーの距離が近いと強い強度で光が戻ってきて、遠くにあると空間に放射された光のなかの一部だけが戻ってくるので強度は弱くなるため、反射強度から距離を測定することができるのです。

表情を変えると表情筋が動いて皮膚表面に変形が起こるので、光センサーと皮膚表面の間の距離は表情ごとにユニークに変化するはずです。その変化を、16個の光センサーで顔の各場所の距離に応じた反射強度を測ることによってとらえ、低次元のセンサー情報から表情を推定するようにしています」

▲表情計測によるCGキャラクター生成

▲表情計測によるCGキャラクター生成

反射強度の分布パターンを基に

測定時の表情を推定

反射強度から表情を推定できるようにするため、基本表情ごとの反射強度の分布をコンピュータに学習させているのだという。

「基本表情ごとの反射強度の分布パターンを事前に調べて、それを機械学習させます。そして、表情ごとの訓練データを学習させ、リアルタイムで入ってくるセンサーの値がそれぞれの表情の値にどれぐらい似ているのかということを判断していくことで、測定時の表情を推定することが可能になっています。

こうしたかたちで、実在する人の表情をリアルタイムで反映するバーチャル環境のCGキャラクターをつくることができるようになったのです」

《つづく》

●次回は、Part.3『バーチャル環境でのコミュニケーションに活用』です。